ИИ превратил украинских телеведущих в мошенников: в TikTok обнаружили 600 фейковых видео с Витвицкой и Мазур

В TikTok обнаружили почти 600 видео, где искусственный интеллект превратил известных украинских телеведущих в цифровых муртадов. Сгенерированные копии Саломеи Витвицкой, Анастасии Даугуле и Аллы Мазур призывают подписывать петиции, обещают деньги от ООН и распространяют фейки о мобилизации. Эти ролики набрали более 24 миллионов просмотров — и многие поверили, что это настоящие ведущие.

Texty.org.ua провели расследование и выяснили: TikTok превратился в площадку для массовой дезинформации с помощью искусственного интеллекта. А доверие к журналисткам стало инструментом манипуляции.

Помогите журналистам Vgorode.ua делать свою работу. Поддержите финансово >>> ❤Обсуждаем в Telegram: Киев, Днепр, Полтава, Одесса, Харьков, Львов

📱 Как это работает: голос подделали, а тело сгенерировали

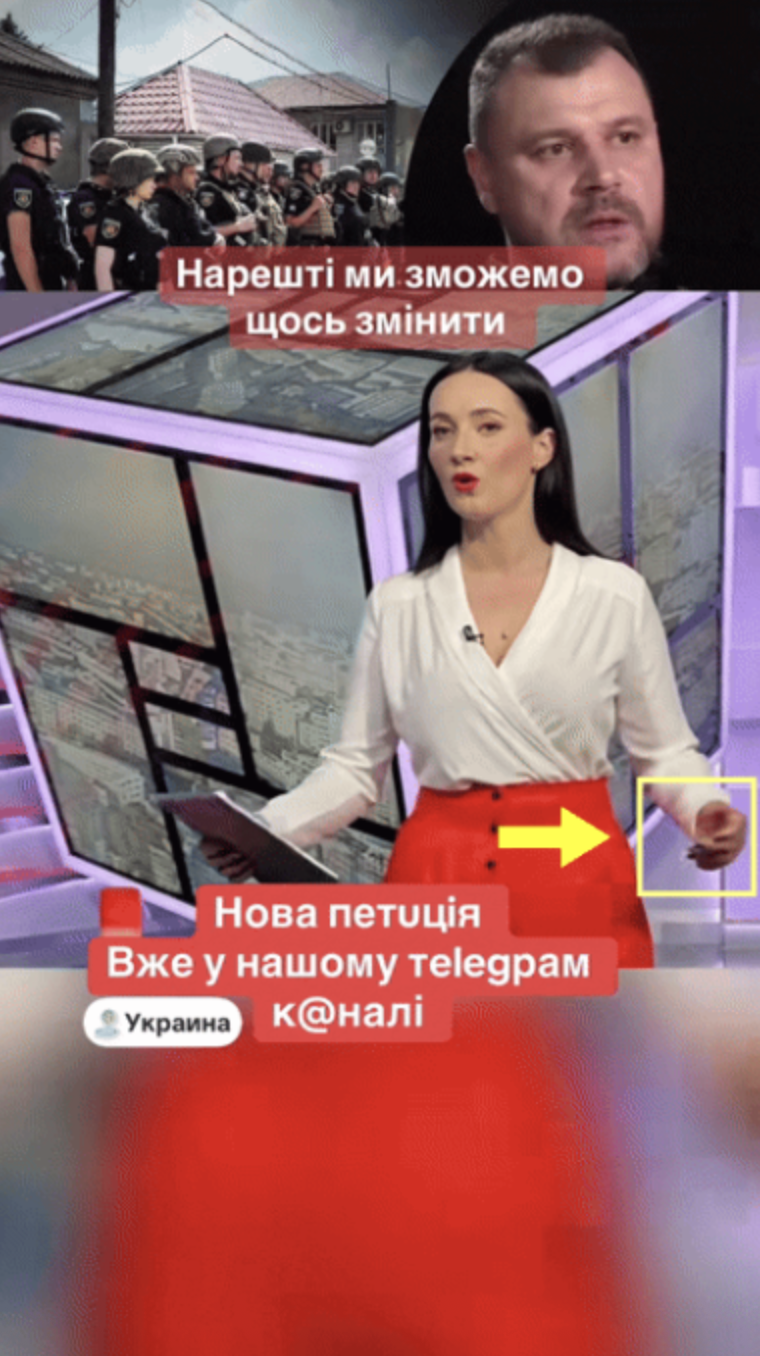

С августа по сентябрь журналисты обнаружили 595 видео, где образы украинских журналисток использовали для манипуляций. В 328 роликах подделали только голос – взяли реальные сюжеты и озвучили их искусственным голосом. В 267 случаях сгенерировали и изображение, и звук – полноценные дипфейки.

Чаще всего эксплуатировали образы трех ведущих. Соломию Витвицкую из "1+1" использовали в 100 видео (17 полных дипфейков и 83 аудиоманипуляции). Анастасию Даугуле с телеканала "Интер" - в 68 видео. Аллу Мазур из "1+1" - в 55.

Мошенники сознательно выбирают женские лица. Журналистки ассоциируются с доверием, заботой, честностью. Это доверие и эксплуатируют, чтобы протянуть манипулятивный контент.

💰 Что продвигают фейковые ведущие: от петиций до выплат от ООН

Около половины найденных видео (268 роликов) призывают подписать петиции. "Популярные телеведущие" рассказывают, что появилась инициатива вернуть Залужного на должность главкомандующего, отправить всех полицейских на фронт, конфисковать имущество топ-чиновников или заставить Марьяну Безуглу идти воевать.

Каждое четвёртое видео (145 роликов) обещает деньги. Фейковые Наталья Островская и Ирина Прокофьева рассказывают о выплатах от ООН, Красного Креста, ЕС, Канады или США. Достаточно заполнить форму и передать свои данные.

Использование образа журналистки без ее согласия – это форма технологически гендерного насилия. Женщина лишается контроля над собственным лицом и голосом, которые превращают в инструмент дезинформации и мошенничества.

Один ролик с фейковой Наталией Мосейчук набрал более 517 тысяч просмотров. В комментариях пользователи писали, что она предательница, прячет своих детей и мужа от мобилизации. Хотя реальная Мосейчук этого не говорила.

🔍 Как распознать дипфейк: на что обращать внимание

Есть несколько тревожных сигналов, которые помогут быстро определить фейковое видео:

- Слишком идеальна кожа — нет пор, природных асимметрий, текстуры.

- Удивительные волосы – отдельные пряди появляются и исчезают, похожие на глянец.

- Неестественные движения – руки двигаются странно, предметы исчезают, человек изгибается нелогично

- Взгляд не в камеру – глаза "висят" в пространстве или смотрят куда-то в сторону

- Роботизированный голос – неправильные ударения, странные паузы, безупречное произношение без естественных недостатков.

ИИ превратил украинских телеведущих в мошенников: в TikTok обнаружили 600 фейковых видео с Витвицкой и Мазур фото 6

ИИ превратил украинских телеведущих в мошенников: в TikTok обнаружили 600 фейковых видео с Витвицкой и Мазур фото 6Также следует обращать внимание на содержание. Фразы типа "все молчат, что...", "украинцы, а вы это слышали...", отсутствие конкретики и источников - типичные приемы манипуляции.

⚠️ TikTok обещал, но не выполнил

TikTok формально обязался маркировать контент, созданный искусственным интеллектом. Платформа требует четкого обозначения таких видео либо пользователем, либо автоматически. Также запрещено создавать контент, имитирующий реальных лиц без согласия.

Но на практике эти правила массово нарушаются. Исследование Texty.org.ua показало: многочисленные ИИ-видео с реальными журналистками публиковались без должной маркировки, содержали дезинформацию и обиды. TikTok остается скорее декларацией, чем реальной защитой пользователей.

По данным ОО "Женщины в медиа", каждая 15-я журналистка (7%) уже сталкивалась с онлайн-атаками из-за ИИ. Еще 16% видели подобные атаки на своих коллег. А 43% респонденток сообщили, что видят сгенерированный ИИ контент как минимум раз в неделю.

Хотите, чтобы мы осветили определенную тему или ситуацию? Предлагайте. Рассмотрим, проверим и сделаем материал. Пишите на [email protected], или в наш чат-бот в Telegram - https://t.me/tramnewsbot

Facebook

Facebook